给AI内容“卸妆”,一眼辨真伪!如何加强管理利用AI造谣乱象?

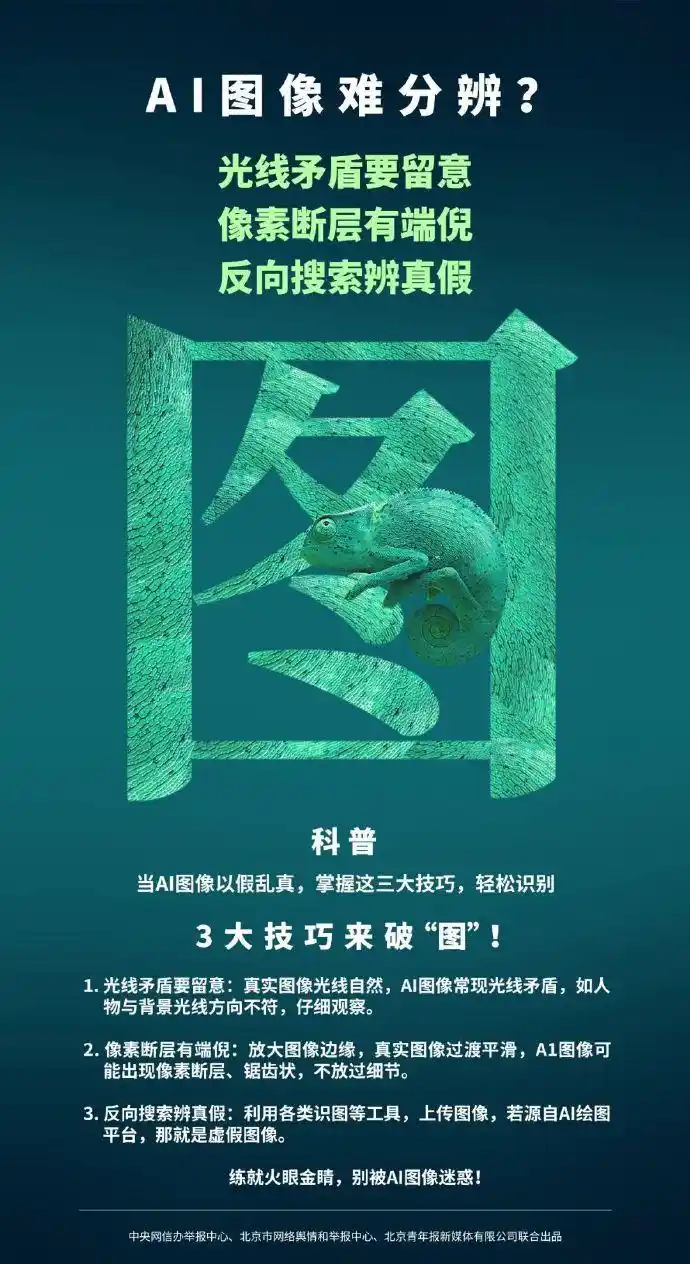

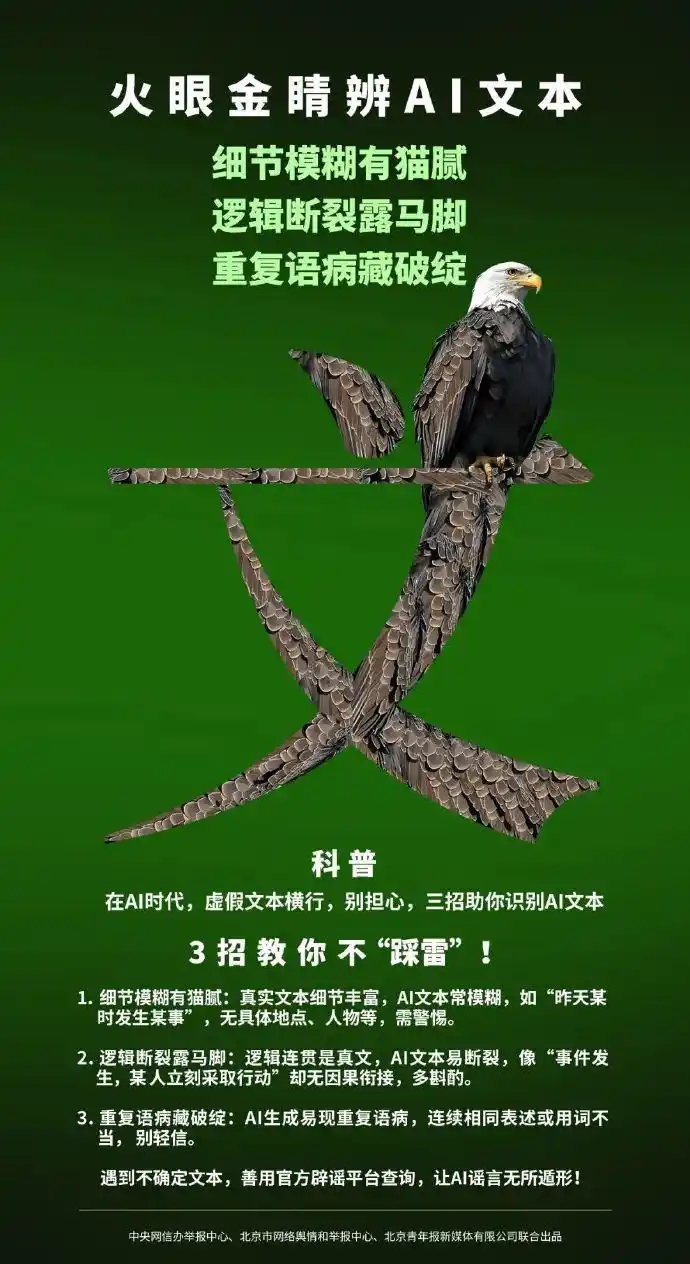

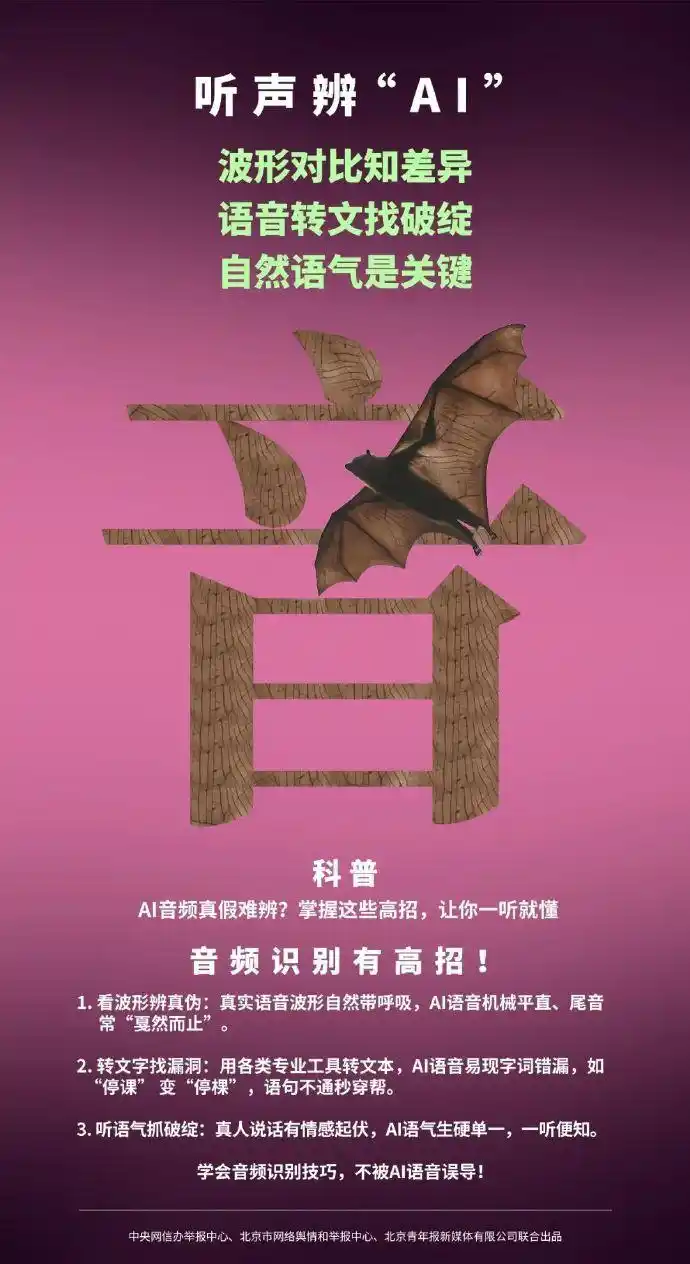

AI技术迅猛迭代,创作的边界不断拓宽,在为我们生活和工作带来便捷的同时,也埋下了传播虚假信息的隐患。今天,让我们聚焦AI图像、AI文本、AI音频三大场景,解锁实用识别技巧。掌握这些方法,就能轻松练就“火眼金睛”。

目前,很多AI生成内容引发的整蛊、造谣乱象,均是内容发布者有意为之,甚至故意绕开平台监管。对此,应如何加强管理?

中国农业大学法律系副教授薛铁成表示,必须明确,蓄意发布AI生成图片、视频整蛊甚至造谣的行为,可能涉嫌违法。若内容发布者明知其行为可能引发恐慌、报警、扰乱社会秩序,仍主动发布AI生成的图片、视频等误导性内容,其主观上可能构成谎报警情的间接故意,最终行为或被认定为报假警。根据治安管理处罚法相关规定,当事人将被处以行政处罚。若情节严重,还可能触犯刑法中的“编造、故意传播虚假信息罪”,须依法承担刑事责任。

加强对内容发布者的管理,要进一步压实平台责任。《人工智能生成合成内容标识办法》采用的是漏洞填补和责任加重的AI标识管理规则。在关涉AI生成内容发布的各个环节中,后一环节对前一环节负有检验和审核的责任。

例如,提供网络信息内容传播服务平台发布AI生成内容时,既需要检验用户提供的AI生成内容是否有平台的隐式标识,还需要检验用户是否声明AI生成内容。如果均没有相关AI内容标识和声明,本平台检测到显式标识或者其他生成合成痕迹的,识别为疑似生成合成内容,也应当采取适当方式在发布内容周边添加显著的提示标识,提醒公众该内容疑似AI生成内容。

西南政法大学公法研究中心执行主任杨尚东则表示,首先,平台应明确AI生成内容的管理规范。平台需制定清晰的AI生成内容管理规则,一方面强制要求用户对AI生成内容进行标注或主动声明;另一方面完善平台细则,针对恶意传播AI违规内容的视频及账号,依法依规采取提示、下架、封号等阶梯式处置措施。

其次,平台应加强AI生成内容的审核与标识。内容发布前,平台应升级审核机制,通过“技术检测+人工复核”的双重模式提升AI内容识别精度,精准筛选出可能扰乱社会秩序的内容及账号,并降低此类整蛊内容的传播权重。内容发布后,平台需在聊天、评论等交互环节,进一步强化AI生成内容的明确标识与风险提示,引导用户理性判断。

最后,平台应建立快速响应与事实核查机制。平台可搭建公众举报通道,及时发现审核疏漏的问题内容。针对可能扰乱公共秩序的信息,第一时间启动事实核查与应急响应,快速采取限流、删除等措施,防止内容扩散造成更大负面影响。

(羊城晚报•羊城派综合自@全国网络举报、法治日报)